|

"

0

C

F

G

H

K

L

N

P

S

T

W

Z

А

Б

В

Г

Д

Е

Ж

З

И

Й

К

Л

М

Н

О

П

Р

С

Т

У

Ф

Х

Ц

Ч

Ш

Э

Ю

Я

ОВРАЖНЫХ ФУНКЦИЙ МЕТОДЫ МИНИМИЗАЦИИЗначение ОВРАЖНЫХ ФУНКЦИЙ МЕТОДЫ МИНИМИЗАЦИИ в математической энциклопедии: - численные методы отыскания минимумов функций многих переменных. Пусть задана ограниченная снизу дважды непрерывно дифференцируемая по своим аргументам функция

для к-рой известно, что при нек-ром векторе

Существует много методов, позволяющих получить указанную последовательность векторов. Однако общим недостатком большинства алгоритмов является резкое ухудшение их свойств в случаях, когда поверхности уровня минимизируемой функции Функции овражного типа локально характеризуются плохой обусловленностью матриц двух производных (матриц Гессе)

что приводит к сильному изменению функции Дважды непрерывно дифференцируемая по своим аргументам функция J(х)наз. овражной функцией (см. [1]), если существует нек-рая область

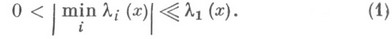

Степень овражности характеризуется числом

Если собственные значения

то число r наз. размерностью оврага функции Системы дифференциальных уравнений, описывающие траекторию спуска овражной функции

являются жесткими дифференциальными системами. В частности, когда функция J(х)сильно выпуклая и матрица Гессе положительно определена (все ее собственные значения строго больше нуля), неравенства (1) совпадают с известным требованием плохой обусловленности матрицы Гессе

В этом случае спектральное число обусловленности совпадает со степенью овражности. Метод покоординатного спуска (см. [2])

несмотря на простоту и универсальность, в овражной ситуации эффективен лишь в редких случаях ориентации оврагов вдоль координатных осей. Предложена (см. [2]) модернизация метода (4), состоящая в использовании процедуры вращения осей координат так, чтобы одна из осей была направлена вдоль Схема метода наискорейшего спуска задается разностным уравнением

где

Для сильно выпуклой овражной функции, в частности квадратичной

последовательность

где С=const,

Так как для овражной функции Аналогичная картина наблюдается и для простой градиентной схемы (см. [4])

Ускорение ее сходимости основано на использовании результатов предыдущих итераций для уточнения дна оврага. Может быть использован (см. [4] [5]) градиентный метод (7) с вычислением на каждой итерации отношения

Далее из точки xk+1 продолжается спуск градиентным методом до следующего ускоряющего шага. Различные версии метода параллельных касательных (см. [4] - [6]) основаны на выполнении ускоряющего шага вдоль направления

Вметоде оврагов (см. [7]) предлагается провести локальные спуски градиентным методом (7) из двух случайно выбранных исходных точек, а затем выполнить ускоряющий шаг по направлению, задаваемому двумя полученными на дне оврага точками. Все эти методы немногим сложнее градиентного метода (7) и построены на его основе. Ускорение сходимости получается для одномерных оврагов. В более общих случаях многомерных оврагов, где сходимость этих схем резко замедляется, приходится обращаться к более мощным методам квадратичной аппроксимации, в основе к-рых лежит метод Ньютона

Точка минимума функции (6) удовлетворяет системе линейных уравнений

и при условии абсолютной точности всех вычислений для квадратичной функции метод Ньютона независимо от степени овражности (2) и размерности оврагов приводит к минимуму за один шаг. На самом деле, при больших числах обусловленности k(D)при ограниченной разрядности вычислений задача получения решения (9) может быть некорректной, и небольшие деформации элементов матрицы Dи вектора При умеренных степенях овражности в выпуклой ситуации метод Ньютона часто оказывается более предпочтительным по скорости сходимости, чем другие, напр, градиентные, методы. Большой класс квадратичных (квазиньютоновских) методов основан на использовании сопряженных направлений (см. [2], [3], [8]). Эти алгоритмы для случая минимизации выпуклой функции оказываются весьма эффективными, ибо, имея квадратичное окончание, они не требуют вычисления матрицы двух производных. Иногда (см. [8]) итерации строятся по схеме

где Е- единичная матрица. Скаляр

Существует ряд аналогичных подходов (см. [8]), основанных на получении строго положительно определенных аппроксимаций матрицы Гессе. При минимизации овражных функций такие алгоритмы оказываются малоэффективными из-за трудностей в подборе параметров Более целесообразно обобщение метода Ньютона на случай минимизации овражных функций проводится на базе непрерывного принципа оптимизации. Функции J(х)ставится в соответствие дифференциальная система (3), интегрируемая системным методом (см. Жесткая дифференциальная система). Алгоритм минимизации принимает вид

Предложен [1] алгоритм минимизации овражной функции, основанный на использовании свойств жестких систем. Пусть функция

где Вместе с тем система дифференциальных уравнений спуска для овражной функции (6)

имеет решение, в к-ром в силу условия (1) слагаемые с сомножителями Другими словами, компоненты вектора х(t)удовлетворяют равенству

быстро переходящему в стационарную связь

где

По функции (13) с помощью конечноразностной аппроксимации находится новая матрица

Если степень овражности не понижается или понижается незначительно, то процесс исключения координат вектора хпродолжается рекурсивно до необходимого ее уменьшения. Лит.:[1] Ракитский Ю. В., Устинов С. М., Черноруцкий И. Г., Численные методы решения жестких систем, М., 1979; [2] Сеа Ж., Оптимизация. Теория и алгоритмы, пер. с франц., М., 1973; [3] Пшеничный Б. Н., Данилин Ю. М., Численные методы в экстремальных задачах, М., 1975; [4] Поляк Б. Т., "Экономика и математич. методы", 1967, т. 3, № 6, с. 881-902; [5] Фаддеев Д. К., Фаддеева В. Н., Вычислительные методы линейной алгебры, 2 изд., М., 1963; [6] Уайлд Д.- Д ж., Методы поиска экстремума, пер. с англ., М., 1967; [7] Гельфанд И. М., Цетлин М. Л., "Докл. АН СССР", 1961, т. 137, № 2, с. 295-98; [8] Численные методы условной оптимизации, пер. С англ., М., 1977. Ю. В. Ракитский. |

|

|

|

(

( - знак транспонирования) она принимает наименьшее значение. Требуется построить последовательность векторов такую, что

- знак транспонирования) она принимает наименьшее значение. Требуется построить последовательность векторов такую, что

имеют структуру, сильно отличающуюся от сферической. В этом случае нек-рую область

имеют структуру, сильно отличающуюся от сферической. В этом случае нек-рую область  , в к-рой норма вектора-градиента

, в к-рой норма вектора-градиента  существенно меньше, чем в остальной части пространства, наз. дном оврага, а саму функцию - овражной функцией. Если размерность пространства аргументов минимизируемой функции больше двух, то структура поверхностей уровня овражных функций может оказаться весьма сложной. Появляются (т-к)-мерные овраги, где число кизменяется от 1 до т-1. В трехмерном пространстве, напр., возможны одномерные и двумерные овраги.

существенно меньше, чем в остальной части пространства, наз. дном оврага, а саму функцию - овражной функцией. Если размерность пространства аргументов минимизируемой функции больше двух, то структура поверхностей уровня овражных функций может оказаться весьма сложной. Появляются (т-к)-мерные овраги, где число кизменяется от 1 до т-1. В трехмерном пространстве, напр., возможны одномерные и двумерные овраги.

вдоль направлений, совпадающих с собственными векторами матрицы Гессе для больших собственных чисел, и к слабому изменению вдоль других направлений, отвечающих малым собственным значениям матрицы Гессе. Большинство известных методов оптимизации позволяет достаточно быстро попадать на дно оврага, приводя иногда к существенному уменьшению значения функции J(х)по сравнению с его значением в начальной точке (спуск на дно оврага). Однако далее процесс резко замедляется и практически останавливается в нек-рой точке из Q, к-рая может быть расположена очень далеко от истинной точки минимума.

вдоль направлений, совпадающих с собственными векторами матрицы Гессе для больших собственных чисел, и к слабому изменению вдоль других направлений, отвечающих малым собственным значениям матрицы Гессе. Большинство известных методов оптимизации позволяет достаточно быстро попадать на дно оврага, приводя иногда к существенному уменьшению значения функции J(х)по сравнению с его значением в начальной точке (спуск на дно оврага). Однако далее процесс резко замедляется и практически останавливается в нек-рой точке из Q, к-рая может быть расположена очень далеко от истинной точки минимума. , где собственные значения матрицы Гессе

, где собственные значения матрицы Гессе  , упорядоченные в любой точке

, упорядоченные в любой точке  по убыванию модулей, удовлетворяют неравенствам

по убыванию модулей, удовлетворяют неравенствам

в области Gудовлетворяют неравенствам

в области Gудовлетворяют неравенствам

при

при  (см. [1]).

(см. [1]). ,

,

после чего начинается поиск на (k+1)-м шаге. Такой подход приводит к тому, что одна из осей имеет тенденцию выстраиваться вдоль образующей дна оврага, позволяя в ряде случаев весьма успешно проводить минимизацию функций с одномерными оврагами. В случае многомерных оврагов метод непригоден.

после чего начинается поиск на (k+1)-м шаге. Такой подход приводит к тому, что одна из осей имеет тенденцию выстраиваться вдоль образующей дна оврага, позволяя в ряде случаев весьма успешно проводить минимизацию функций с одномерными оврагами. В случае многомерных оврагов метод непригоден.

выбирается из условия

выбирается из условия

построенная алгоритмом (5), сходится к точке минимума функции

построенная алгоритмом (5), сходится к точке минимума функции  по закону геометрия, прогрессии (см. [3])

по закону геометрия, прогрессии (см. [3])

и сходимость практически отсутствует.

и сходимость практически отсутствует.

Когда оно устанавливается около нек-рого постоянного значения

Когда оно устанавливается около нек-рого постоянного значения  , делается большой ускоряющий шаг согласно выражению

, делается большой ускоряющий шаг согласно выражению

задаваемого точками

задаваемого точками  в градиентном методе. В методе "тяжелого шарика" (см. [4]) очередное приближение имеет вид

в градиентном методе. В методе "тяжелого шарика" (см. [4]) очередное приближение имеет вид

могут приводить к большим вариациям

могут приводить к большим вариациям

подбирается так, чтобы матрица

подбирается так, чтобы матрица  была положительно определенной и чтобы

была положительно определенной и чтобы

и т. д. Выбор этих параметров основан на информации о величине наименьших по модулю собственных значений матрицы Гессе, а при реальных вычислениях и большой степени овражности эта информация сильно искажена.

и т. д. Выбор этих параметров основан на информации о величине наименьших по модулю собственных значений матрицы Гессе, а при реальных вычислениях и большой степени овражности эта информация сильно искажена.

в окрестности

в окрестности  аппроксимируется квадратичной функцией (6). Матрица Dи вектор

аппроксимируется квадратичной функцией (6). Матрица Dи вектор  вычисляются, напр., с помощью конечно-разностной аппроксимации. Из представления элементов матрицы

вычисляются, напр., с помощью конечно-разностной аппроксимации. Из представления элементов матрицы

-ортонормированный базис собственных векторов D, следует, что неточное измерение этих элементов искажает информацию о малых собственных значениях плохо обусловленной матрицы, а следовательно, приводит к некорректности задачи минимизации функции (6).

-ортонормированный базис собственных векторов D, следует, что неточное измерение этих элементов искажает информацию о малых собственных значениях плохо обусловленной матрицы, а следовательно, приводит к некорректности задачи минимизации функции (6).

оказывают влияние лишь на малом начальном отрезке длиной

оказывают влияние лишь на малом начальном отрезке длиной

- компоненты вектора, удовлетворяющие равенству (12). Это свойство используется в алгоритме. Выражая j-ю компоненту вектора

- компоненты вектора, удовлетворяющие равенству (12). Это свойство используется в алгоритме. Выражая j-ю компоненту вектора  , к-рой соответствует максимальная компонента вектора

, к-рой соответствует максимальная компонента вектора  , через остальные компоненты, вместо функции

, через остальные компоненты, вместо функции  , получают новую функцию с аргументом размерности

, получают новую функцию с аргументом размерности  :

:

порядка ( т-1) и вектор

порядка ( т-1) и вектор  Здесь важно не только и не столько понижение размерности пространства поиска, сколько уменьшение степени овражности, т. к. при минимизации новой функции в подпространстве, ортогональном вектору u1, большое собственное значение уже не оказывает влияния на вычислительный процесс. Самым существенным моментом здесь является требование получения

Здесь важно не только и не столько понижение размерности пространства поиска, сколько уменьшение степени овражности, т. к. при минимизации новой функции в подпространстве, ортогональном вектору u1, большое собственное значение уже не оказывает влияния на вычислительный процесс. Самым существенным моментом здесь является требование получения  по функции (13), а не по матрице Dи вектору

по функции (13), а не по матрице Dи вектору  . Коэффициенты связи (12) находят степенным методом, как коэффициенты любого уравнения системы

. Коэффициенты связи (12) находят степенным методом, как коэффициенты любого уравнения системы